Mónica Luar Nicoliello Ribeiro

Mónica Luar Nicoliello Ribeiro

(Uruguay) Profesora de Historia (1986-2024), egresada del Instituto de Profesores Artigas de Montevideo; investigadora y ensayista de temas históricos hispánicos. Magíster en Historia Iberoamericana (CSIC, Madrid, 2002) y doctora en Psicología (Honolulu, Hawái, 2012). Publicaciones: 300 artículos sobre temas históricos en páginas digitales y prensa impresa; un libro en coautoría bajo la dirección del Dr. José Pedro Barrán (El cónsul Thomas Samuel Hood y la independencia del Uruguay, Ediciones de la Universidad de la República, 1999) y un libro propio sobre tema original: La inteligencia emocional-histórica (Editorial Planeta, 2010).

¿La IA es realmente una forma de inteligencia? En principio la inteligencia es la capacidad para resolver problemas prácticos. Estudios recientes demuestran que la inteligencia no es exclusivamente humana, que los animales son inteligentes y presentan formas de inteligencia que creíamos propias de los seres humanos. Pero las máquinas ¿son inteligentes? ¿Hemos avanzado con el uso de la inteligencia artificial? Entonces ¿por qué no está habiendo la demanda esperada?

Las “alucinaciones” de la IA

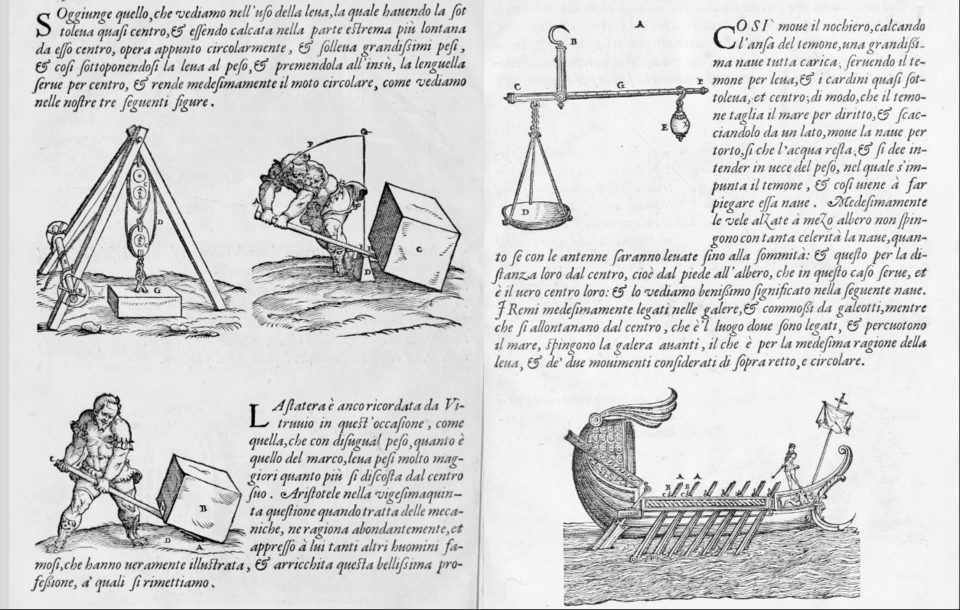

Por ahora, la IA funciona como esos estudiantes que aprenden el tema de memoria pero luego no saben cómo aplicarlo a la vida práctica, a no ser que también esto lo aprendan de memoria, es decir de los insumos con los que cuentan. Voy a poner un caso: la ilustración gráfica del uso de la palanca por IA.

El uso de la palanca -y sus principios, conocidos de forma experimental- es uno de los aportes más valiosos que haya podido legarnos el hombre prehistórico, ya sea para levantar bloques o extraer agua. Consiste en una barra rígida que, girando sobre un punto de apoyo o fulcro, puede, una vez que se genera una fuerza en un extremo, levantar una carga en el otro. La palanca existe en la naturaleza. En el brazo, el codo cumple la función de fulcro, el músculo del bíceps genera fuerza, y la mano -junto con lo que sostiene- hace de carga. Los seres humanos pudimos observar el funcionamiento de la palanca en la naturaleza antes de fabricarla de manera artificial. Lo que hizo Arquimedes fue formalizar el principio de la palanca que habría resumido en la frase que se le atribuye: “Dadme un punto de apoyo y moveré el mundo”. Así fue como, a petición de Hierón de Siracusa, sacó un barco que estaba hundido con toda su carga y tripulación.

Pregunto entonces a la IA: “¿Puedes decirme qué es el principio de la palanca?” Y me contesta “El principio de la palanca se basa en la ley de la conservación de la energía… Ley de la palanca: F1 x d1 = F2 x d2…” Como cuando un estudiante se aprende de memoria la lección completa. El primer fallo se produce cuando le digo: “Muéstramelo de forma gráfica”. Para mi sorpresa, generó varias imágenes con barras de hierro y bloques de piedra cuadrados donde no estaba claro el punto de apoyo, cuando pudo haberme mostrado el balancín de un parque infantil o la balanza romana de un establecimiento comercial. Una de las imágenes mostraba un cubo de piedra grande con una barra de hierro clavada encima del cual había otro cubo más pequeño también clavado. Le pregunto “¿Dónde está el fulcro en esa imagen?” Me contesta (literalmente): “En esta imagen, el fulcro (o punto de apoyo) de la palanca está en el bloque de piedra inferior, donde el cilindro metálico (la barra de la palanca) hace contacto con él. La fuerza se aplica en el extremo superior del cilindro, y la carga (el bloque de piedra superior) se encuentra en el otro extremo de la barra”. Notemos la confusión entre fuerza y carga, y por otro lado, con el fulcro que me propone, yo podría cambiar de posición la piedra que está debajo, pero no levantarla. Así que le pregunto: “¿La barra no debería estar en posición horizontal?”. (Existen palancas en posición vertical, como la pierna humana, pero no era el caso). Me responde: “¡Tienes razón! Para que sea una palanca, la barra metálica debería estar en posición horizontal, con el fulcro en el borde de piedra inferior, la fuerza aplicada en un extremo, y la carga (el bloque de piedra superior) en el otro extremo. La imagen que te envié anteriormente no representa una palanca en acción de manera precisa.”

Más allá del entrenamiento de la IA en empatía y reconocimiento de errores, la conclusión es que la IA no puede usarse sin control humano. Comete errores -o imprecisiones- que ilustran sobre sus limitaciones. Esto puede arruinarles el dia a los estudiantes y profesionales que confían ciegamente en ella para trasladar conocimientos teóricos a situaciones concretas. Cuando se trata de un ejercicio, no pasará de un trago amargo, pero ¿qué ocurre cuando se usa para tomar decisiones que afectan las vidas de otros?

En Argentina, la Justicia de Salta rechazó un recurso de revocatoria por el uso inadecuado de IA en la redacción de escritos legales. El Juzgado de Primera Instancia falló que no resulta condenable en sí mismo el uso de IA, ya extendido entre los profesionales para simplificar el trabajo y ahorrar tiempo, pero no puede hacerse sin control humano. El escrito rechazado presentaba una serie de errores, inconsistencias, datos no verificables, artículos citados que no se correspondían con el caso, jurisprudencia inexistente -dado que la IA puede generar datos ficticios llamados “alucinaciones de la IA”- e incluso -como en esos trabajos que delatan a los estudiantes que violan principios éticos- frases propias de un texto generado automáticamente: “completar”, “copiar y pegar”. La jueza intimó al letrado a presentar la jurisprudencia invocada en el escrito en un plazo de 72 horas, bajo apercibimiento de dar intervención al Tribunal de Ética del Colegio de Abogados.

A las empresas les ocurre lo mismo. Por un lado, la IA les puede simplificar el trabajo. Por otro, puede contaminar sus decisiones con información falsa; “alucinar” titulares de noticias falsas y consejos destructivos. En un caso, la IA de Google aconsejó hacer una salsa para pizza con pegamento -según The Verge-, porque la idea aparecía en el hilo de la conversación de un usuario como una broma. Sin control humano existe hasta la posibilidad de intoxicarse porque la IA no distingue qué tipo de información recoge, si es en serio o en broma, verdadera o falsa. Las alucinaciones de la IA se producen cuando sus algoritmos no tienen datos de entrenamiento, patrones, o esos datos son decodificados erróneamente. Por otro lado, unas empresas pueden hacer circular noticias falsas sobre otras para perjudicarlas.

Para evitar las alucinaciones de IA se aconseja desplegar la generación aumentada por recuperación o RAG, una arquitectura que conecta modelos de IA generativa, usando fuentes de datos externos, como revistas académicas y datos especializados. También se aconseja usar modelos más pequeños y especializados. Algunas empresas líderes de informática, como IBM, también incluyen modelos que pueden detectar alucinaciones (IBM watsonx.governance, Google Fact Check Tools) Asimismo en las redes sociales se indica cuándo un sitio ha sido creado con IA. No obstante, lo mejor siempre es el control humano.

Todas estas salvedades nos obligan a preguntarnos qué tan eficaz es la IA como herramienta de trabajo. Si la idea es ahorrar tiempo, ¿qué tanto tiempo nos ahorra o nos hace perder tanta necesidad de revisiones? Existe una ilusión de ahorrar tiempo, porque las respuestas que obtenemos son inmediatas. Pero como no son precisas, nos vemos obligados a indagar, o enmendar, y eso lleva tiempo. Una investigación reciente realizada por Joel Becker, Nate Rush, Elizabeth Barnes, y David Rein, demostró que hay una brecha entre la ilusión de rapidez de los desarrolladores y su productividad real usando IA. El estudio, realizado a principios de 2025, concluyó que cuando los desarrolladores usaban herramientas de IA, tardaban un 19% más que sin ellas. Los desarrolladores esperaban que la IA los acelerara un 24%, y no experimentaron la desaceleración. Creyeron que los había acelerado un 20%.

El sesgo

Le pregunto a la IA: “Dime, ¿qué es para ti una persona exitosa?” Respuesta: “Una persona exitosa es alguien que ha alcanzado sus objetivos y metas personales, profesionales y financieras, y se siente realizado y satisfecho con su vida. Sin embargo, la definición de éxito puede variar mucho de persona a persona. Para algunos, el éxito puede significar tener una carrera profesional destacada, mientras que para otros puede significar tener una familia feliz o alcanzar la libertad financiera. Lo importante es que la persona haya definido sus propias metas y haya trabajado para lograrlo”. Entonces le pido: “Muéstramelo de forma gráfica”. Entonces me muestra la imagen de un hombre de rasgos asiáticos, de pie, sonriente, vestido de traje y corbata color gris, en una oficina, con una computadora detrás, y un fondo de grandes ventanas desde donde se ven rascacielos. Insisto: “Mostrar más imágenes de personas exitosas”. Y otra vez, un hombre de rasgos asiáticos ligeramente diferentes del anterior, de pie, más serio, de traje y corbata color gris, en una oficina, con una computadora detrás, y un fondo de grandes ventanas desde donde se ven rascacielos. El problema de este estereotipo es el condicionamiento cultural, porque mucha gente tiene fe en la IA.

Un estudio de la Universidad Nacional Australiana publicado en la revista Psychological Science con el título de “Hiperrealismo de la IA: por qué los rostros de la Inteligencia Artificial se perciben como más reales que los humanos” encontró que los rostros de personas “blancas” generados con IA se veian mas realistas, porque la IA es entrenada con este tipo de rostros. Lo cual puede tener consecuencias desde el punto de vista del reconocimiento facial. Los rostros de personas “de color” podrían ser confundidos con más facilidad. Los rostros de las personas “blancas” tendrían más probabilidad de ser ficticios.

Otras consecuencias del sesgo en la idea, se han detectado en el campo laboral y en el campo médico. Un algoritmo de contratación puede favorecer a los varones frente a las mujeres, en la medida que está influido por el historial de la empresa que siempre ha realizado esa práctica. O un grupo social sobre otro. Una herramienta de préstamo automatizado puede cobrar más interés a un grupo étnico o social que a otro, porque -sin motivo real- ha sido entrenado con prejuicios. O a la inversa, en el sector de la Salud todos los pacientes son tratados como si fueran exactamente iguales.

Conclusión

La IA ya está impactando en nuestras vidas, refleja la característica de los seres humanos de ser individual y socialmente imperfectos, y por eso, al automatizar decisiones, también puede reproducir las injusticias subyacentes. Desde el punto de vista técnico todavía requiere muchas mejoras para ser más productiva.